What is sonification/es: Difference between revisions

(Created page with "El Centro Iannis Xenakis ha desarrollado una versión educativa moderna de UPIC en forma de aplicación, titulada UPISKETCH, que está disponible gratuitamente en esta página: https://www.centre-iannis-xenakis.org/upisketch?lang=en") |

|||

| Line 118: | Line 118: | ||

El Centro Iannis Xenakis ha desarrollado una versión educativa moderna de UPIC en forma de aplicación, titulada UPISKETCH, que está disponible gratuitamente en esta página: https://www.centre-iannis-xenakis.org/upisketch?lang=en | |||

Revision as of 10:48, 8 April 2026

Cuando emitimos un sonido para comunicar algo, estamos aplicando un sistema de sonificación. Representamos datos en el ámbito auditivo. Convertimos datos en sonidos; estos datos suelen representar cualquier cosa que pueda expresarse en números: una medida física, un concepto, una acción o el seguimiento vectorial de una secuencia de valores procedentes de un sensor. Se han creado muchas definiciones para este proceso denominado sonificación: desde "subtipo de representaciones auditivas que utilizan audio no verbal para representar información", hasta "transformación de relaciones de datos en relaciones percibidas en una señal acústica con el fin de facilitar la comunicación o la interpretación" [1] y, de una manera más definitiva y precisa, "generación de sonido dependiente de datos, si la transformación es sistemática, objetiva y reproducible" [2], y, por último, "técnica de transformación de datos no audibles en sonido que puede ser percibido por el oído humano" [3]. Para simplificarlo en el contexto de este manual, podemos afirmar brevemente que "la sonificación es el proceso de generar sonido a partir de cualquier tipo de datos para representar su información en forma de audio". En términos aún más sencillos, podemos decirle a un estudiante que la sonificación describe los datos con sonido del mismo modo que la visualización lo hace con gráficos, diagramas de flujo, histogramas, etc.

En resumen, queremos combinar datos (entrada) y sonidos (salida), y determinar la forma en que ambos se relacionan (correspondencia o protocolo). Por lo tanto, un sistema de sonificación se define por estas tres partes:

1 - Datos de entrada 2 - Sonidos de salida 3 - Asignación o protocolo

Tipo de datos y uso de la sonificación

La sonificación se utiliza cada vez más como herramienta científica para analizar y supervisar datos de diversos fenómenos, y ha evolucionado especialmente en la comunidad astronómica debido a las grandes cantidades de datos que se generan al observar el cosmos, pero también como herramienta artística y complemento educativo de otras disciplinas como la medicina, las matemáticas, la física, la química, así como la geografía, la economía o incluso la literatura. Por ejemplo, en medicina, los médicos supervisan las reacciones biométricas de los pacientes en tiempo real sin tener que mirar una pantalla. En literatura, se puede crear una representación sonora "a posteriori" (posteriormente) utilizando el número de adjetivos de un libro o el número de veces que aparece una determinada palabra en un artículo. Cualquier tipo de dato está compuesto por números. Y los números pueden generar sonido, ya que la música y el sonido se reducen fundamentalmente a números, en el sentido de que podemos describirlos utilizando números.

Usos de la sonificación

El objetivo de la sonificación es representar, mostrar y compartir datos. Al recurrir al ámbito auditivo, los datos pueden resultar más accesibles y comprensibles para el mayor número posible de usuarios, especialmente para aquellas personas que tienen dificultades para interpretar las representaciones visuales de los datos; además, puede utilizarse para que los datos resulten más atractivos y fáciles de recordar para todo el mundo. La sonificación se puede utilizar en una gran variedad de aplicaciones, como la visualización de datos científicos, la monitorización de condiciones ambientales y la creación de experiencias multimedia interactivas, pero también en la educación, a la hora de involucrar a los estudiantes en la comprensión de un concepto científico utilizando estímulos auditivos en lugar de visuales. A continuación se muestran algunos ejemplos de cómo se utiliza la sonificación en el mundo real: Análisis de datos científicos: La sonificación puede utilizarse para analizar datos que son demasiado complejos o abstractos para ser representados visualmente. Por ejemplo, los científicos han utilizado la sonificación para analizar el comportamiento de los átomos (Los sonidos de los átomos)[4], la actividad de las neuronas en el cerebro (Software interactivo para la sonificación de la actividad neuronal | HAL) [5] , y la evolución de las galaxias (https://chandra.si.edu/sound/gcenter.html). La sonificación también puede aplicarse cuando los datos se registran en una secuencia demasiado densa y, por lo tanto, la manipulación del tiempo permite un escalado audible o transformaciones sonoras en duraciones mayores o menores, como al transformar el sismógrafo de un terremoto en sonido. Monitorización de las condiciones ambientales: La sonificación puede utilizarse para monitorizar las condiciones ambientales en tiempo real, por ejemplo, para monitorizar el sonido del océano con el fin de rastrear cambios en la temperatura del agua y los niveles de contaminación [6] Creación de experiencias multimedia interactivas: La sonificación puede utilizarse para crear experiencias multimedia interactivas que son más inmersivas y atractivas que las interfaces visuales tradicionales. Por ejemplo, la sonificación se ha utilizado para crear mapas interactivos [7], juegos educativos (CosmoBally - Sonokids) y experiencias de realidad virtual.

Sonificación en tiempo real frente a "a posteriori"

Según el uso que se le dé al sistema de sonificación (para analizar o para monitorizar un fenómeno determinado), distinguimos dos "modos": 1) en tiempo real (para monitorizar): un flujo de datos se sonifica al instante y se genera un sonido que muestra el valor y el comportamiento de los datos en ese momento concreto; 2) "a posteriori" (para analizar): la sonificación de series temporales de un conjunto de datos pregrabados se convierte en un archivo de audio que muestra los valores y el comportamiento de los datos a lo largo del periodo de tiempo que abarca la serie temporal. Estos dos métodos no son mutuamente excluyentes y pueden llegar a mostrar los mismos sonidos. La diferencia radica en que, en el modo «a posteriori», dado que el sonido se produce después de que hayan ocurrido los eventos que originaron los datos, se pueden adaptar los parámetros de la pieza final, es decir, la duración total. En el caso del tiempo real, se puede controlar la resolución temporal: es decir, el intervalo de tiempo en el que el sonido puede cambiar y se reproduce.

Ecología acústica

La estética es importante. Un sonido puede estar mapeado con gran precisión, pero resultar "horrible" para el usuario. Esto podría considerarse un defecto y, por lo tanto, limitar la eficacia del sistema, ya que el usuario no soportará escucharlo. Por otro lado (por ejemplo, en las alarmas), el sonido puede ser intencionadamente estridente y agresivo. La elección del sonido de salida es, en cierto modo, artística, en el sentido de que debe tener en cuenta el tipo de público y sus gustos. Esto no significa que estemos obligados a reproducir algo que le guste al usuario, pero al menos debemos ser conscientes de qué tipo de sonido le resulta familiar. Aunque el gusto sea subjetivo, nos gustaría recordar el trabajo realizado en el campo de la ecología acústica. Existen algunos factores comunes señalados por los estudios de psicología y también por los modelos culturales de «belleza». En el presente proyecto, como sugiere el nombre del mismo, hacemos referencia al trabajo y la visión del compositor canadiense Murray Schafer, quien popularizó el término «paisaje sonoro» en el libro «The Tuning Of The World» en 1977[8]. Los paisajes sonoros pueden considerarse simplemente como una composición de la antropofonía, la geofonía y la biofonía de un entorno concreto. El autor sostiene que nos hemos insensibilizado ante los ricos sonidos de nuestro entorno, a los que él denomina «paisaje sonoro». Este paisaje sonoro abarca todos los sonidos naturales y artificiales que nos rodean, y Schafer cree que deberíamos aprender a apreciarlo y gestionarlo para lograr un mundo mejor. Su trabajo dio lugar al "movimiento de la ecología acústica", cuyo objetivo es estudiar la relación entre los seres humanos, los animales y la naturaleza, en términos de sonido y paisajes sonoros. El Instituto de Ecología Acústica se fundó para concienciar sobre el efecto de los entornos acústicos ruidosos, que se ha demostrado que son perjudiciales al aumentar los niveles de estrés de las personas cuando se encuentran inmersas en ellos.

Ejemplos

SonarX es un software diseñado para transformar imágenes y vídeo en sonido significativo para personas ciegas y todos[9]. Se ejecuta en Pure Data [10] y se puede descargar en este repositorio de GitHub [11] a fecha de 23 de septiembre de 2024.

Algunos elementos históricos

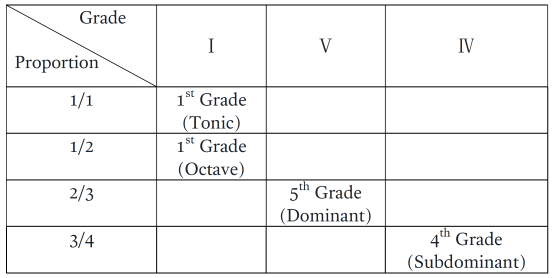

Los grados de la escala musical como sonificación de las proporciones fundamentales (1/2, 2/3, 3/4)

En el sentido más estricto de la Teoría de la Armonía en la Música, la comprensión de las relaciones armónicas que rigen los sonidos se basa en las proporciones matemáticas que corresponden a las dimensiones de longitud, tensión y las propiedades naturales de los materiales que los producen. [12]. La definición del rango general y los intervalos que rigen la escala diatónica se refieren claramente a las proporciones fundamentales de la "Tetraktys" pitagórica.

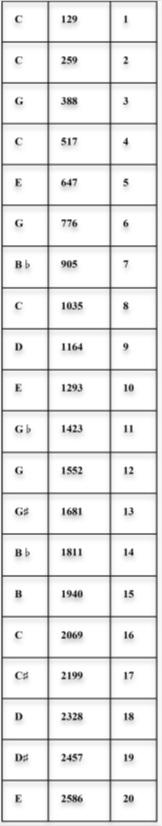

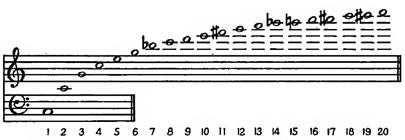

Las proporciones

Si calculamos el número de partes del material que se ponen en movimiento, es decir, si el número “2” corresponde a las dos partes iguales en las que se divide una cuerda para producir la octava (que es de nuevo Do, como se muestra en la primera columna, pero más agudo), y suponiendo que se requieren 129 pulsos para producir Do (Do), entonces la tabla siguiente muestra la correspondencia entre las notas en la columna izquierda y las frecuencias en la columna central, con el número de partes en movimiento en la tercera columna.

La relación de 1 a 2 (1/2) también nos da la relación de intervalos de una octava. Basándonos en el diagrama de frecuencias correspondiente (número de pulsos), la relación de frecuencias es 129/259.

Por lo tanto, la relación de 2 a 3 (2/3) nos da el intervalo, que a su vez define la relación de frecuencias 259/388.

La observación de las relaciones que pueden surgir entre dos o más valores numéricos de cálculo, medición o registro de series de datos, también puede servir como estímulo para la sonorización.

La escala cromática de doce notas, la “teoría de conjuntos” y el serismo holístico

El concepto histórico de "mapear las notas" de la escala diatónica a la secuencia de números naturales se remonta al siglo XVII; sin embargo, el filósofo y músico Jean-Jacques Rousseau (1712-1778) fue el primero en presentar formalmente esta idea en la Academia Francesa de Ciencias.

Según esto, cada nota sucesiva de la escala musical se puede numerar en la secuencia de números naturales.

Por ejemplo, si asignamos a La (La en el solfeo latino) el número 1, entonces tenemos la siguiente correspondencia (tabla de correspondencias):

centro|Un protocolo de sonificación (mapeo de notas) utilizando la escala diatónica

Si la escala también es cromática, entonces podemos tener la siguiente disposición:

centro|Un protocolo de sonificación (mapeo de notas) utilizando la escala cromática

El caso de la “Poliagogia” de Xenakis

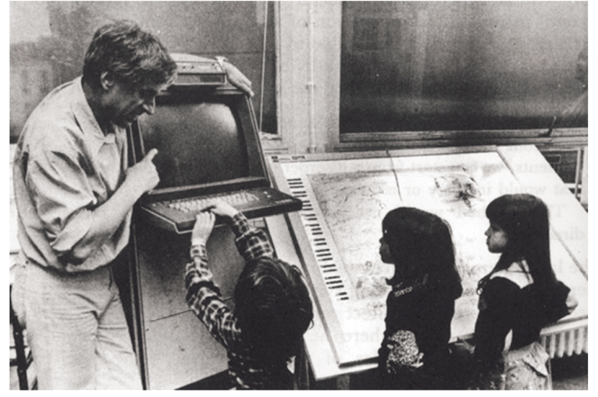

Iannis Xenakis (1922-2001) fue un arquitecto y compositor pionero del siglo XX. El concepto de sonificación esquemática mediante medios electrónicos, como se describió anteriormente —es decir, la conversión de una forma en sonido de manera análoga a la conversión de datos en un gráfico— fue estudiado por Xenakis ya en la década de 1950, pero adquirió su forma definitiva a finales de la década de 1970. Al eludir la mediación de la educación formal, Xenakis se atrevió a establecer un mundo de experiencia sonora holística al concebir, diseñar e implementar la representación sonora de gráficos en forma de un sistema integral. Este sistema incluía un lápiz electromagnético sobre un lienzo de diseño arquitectónico, conectado a una computadora y altavoces; Su nombre en griego era «Polyagogia» («Πολυαγωγία», Unité Polyagogique Informatique de CEMAMu/U.P.I.C.). Xenakis destacó desde el principio la dimensión pedagógica de esta conexión. La imagen que aparece a continuación ilustra claramente esta relación, ya que el lienzo arquitectónico se corresponde con las teclas de un piano (verticalmente en la pantalla).

El Centro Iannis Xenakis ha desarrollado una versión educativa moderna de UPIC en forma de aplicación, titulada UPISKETCH, que está disponible gratuitamente en esta página: https://www.centre-iannis-xenakis.org/upisketch?lang=en

References

- ↑ «The Sonification Report: Status of the Field and Research Agenda», Gregory Kramer, Bruce N. Walker, Terri Bonebright, Perry Cook, John Flowers, Nadine Miner, 1999, International Community for Auditory Display (ICAD)

- ↑ Hermann, T., Walker, B., y Cook, P. R. (2011). Sonification handbook. Springer.

- ↑ Wikipedia, a 9 de abril de 2024

- ↑ " Se ha capturado el sonido de un átomo» (artículo de K 2025) - http://www.themindgap.nl/?p=245

- ↑ Argan Verrier, Vincent Goudard, Elim Hong, Hugues Genevois. Software interactivo para la sonificación de la actividad neuronal. Conferencia sobre Computación Musical y Sonido, AIMI (Associazione Italiana di Informatica Musicale); Conservatorio «Giuseppe Verdi» de Turín, Universidad de Turín, Politécnico de Turín, junio de 2020, Turín (conferencia virtual), Italia. hal-04041917

- ↑ (Sonificación de datos: un aclamado músico transforma datos oceánicos en música) https://www.hubocean.earth/blog/data-sonification a 23 de septiembre de 2024

- ↑ Sonificación 3D interactiva para la exploración de mapas de ciudades | Actas de la 4.ª Conferencia Nórdica sobre Interacción Persona-Ordenador: roles cambiantes

- ↑ Schafer, R. M. (1977). The Tuning of the World. Nueva York: Knopf.

- ↑ S. Cavaco, J.T. Henrique, M. Mengucci, N. Correia, F. Medeiros, Color sonification for the visually impairment, en Procedia Technology, M. M. Cruz-Cunha, J. Varajão, H. Krcmar y R. Martinho (Eds.), Elsevier, volumen 9, páginas 1048-1057, 2013.

- ↑ http://puredata.info/

- ↑ https://github.com/LabIO/Sonarx-45

- ↑ P.Stergiopoulos Música y STEM. Múltiples caras de la misma moneda. Conferencia Internacional | Educadores y educación STE(A)M. Actas de la conferencia STEAM on EDU 2021, págs. 202-220. ISBN: 978-618-5497-24-8. (Enlace: https://www.schoolofthefuture.eu/sites/default/files/2026-02/Music%20and%20STEM%20-%20Multiple%20sides%20of%20the%20same%20coin.pdf)