What is sonification/pt: Difference between revisions

David Sousa (talk | contribs) (Created page with "O conceito histórico de «corresponder as notas» da escala diatônica à sequência dos números naturais remonta ao século XVII; no entanto, foi o filósofo e músico Jean-Jacques Rousseau (1712–1778) o primeiro a apresentar formalmente esta ideia na Academia Francesa de Ciências.") |

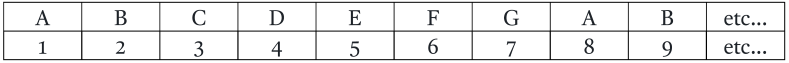

David Sousa (talk | contribs) (Created page with "De acordo com isto, cada nota sucessiva da escala musical pode ser numerada na sequência dos números naturais. Por exemplo, se atribuirmos a A (A na solfejo latina) o número 1, temos a seguinte correspondência (tabela de correspondências):") |

||

| Line 88: | Line 88: | ||

O conceito histórico de «corresponder as notas» da escala diatônica à sequência dos números naturais remonta ao século XVII; no entanto, foi o filósofo e músico Jean-Jacques Rousseau (1712–1778) o primeiro a apresentar formalmente esta ideia na Academia Francesa de Ciências. | O conceito histórico de «corresponder as notas» da escala diatônica à sequência dos números naturais remonta ao século XVII; no entanto, foi o filósofo e músico Jean-Jacques Rousseau (1712–1778) o primeiro a apresentar formalmente esta ideia na Academia Francesa de Ciências. | ||

De acordo com isto, cada nota sucessiva da escala musical pode ser numerada na sequência dos números naturais. | |||

Por exemplo, se atribuirmos a A (A na solfejo latina) o número 1, temos a seguinte correspondência (tabela de correspondências): | |||

Revision as of 11:25, 6 April 2026

Quando emitimos um som para comunicar algo, estamos a aplicar um sistema de sonificação. Representamos dados no domínio auditivo. Transformamos dados em sons; esses dados podem, geralmente, representar qualquer coisa que possa ser expressa em números: uma medição física, uma noção, uma ação ou uma sequência de valores provenientes de um sensor. Foram criadas muitas definições para este processo denominado sonificação: desde «subtipo de representações auditivas que utilizam áudio não verbal para representar informação», até «transformação de relações de dados em relações percebidas num sinal acústico com o objetivo de facilitar a comunicação ou a interpretação». [1] e, de forma mais definitiva e precisa, «geração de som dependente de dados, desde que a transformação seja sistemática, objetiva e reproduzível» [2], e, por fim, «técnica de transformar dados não audíveis em som que possa ser captado pelo ouvido humano» [3]. Para simplificar, no contexto deste manual, podemos afirmar resumidamente que «a sonificação é o processo de gerar som a partir de qualquer tipo de dados para representar a informação que estes contêm sob a forma de áudio». Em termos ainda mais simples, podemos explicar a um aluno que a sonificação descreve os dados através do som, tal como a visualização o faz através de gráficos, fluxogramas, histogramas, etc.

Basicamente, queremos combinar dados (entrada) e sons (saída) e definir a forma como estes dois se relacionam (mapeamento ou protocolo). Assim, um sistema de sonificação é definido por estas três partes:

1 - Dados de entrada 2 - Sons de saída 3 - Mapeamento ou protocolo

Tipo de dados e utilização da sonificação

A sonificação é cada vez mais utilizada como ferramenta científica para analisar e monitorizar dados de vários fenómenos, tendo evoluído especialmente na comunidade astronómica devido às grandes quantidades de dados produzidos pela observação do cosmos, mas também como ferramenta artística e complemento educativo para outras disciplinas, como a medicina, a matemática, a física, a química, mas também a geografia, a economia ou mesmo a literatura. Por exemplo, na medicina, os médicos monitorizam as reações biométricas dos pacientes em tempo real sem terem de olhar para um ecrã. Na literatura, é possível criar uma representação áudio «a posteriori» utilizando o número de adjetivos num livro ou o número de vezes que uma determinada palavra aparece num artigo. Qualquer tipo de dados é composto por números. E os números podem desencadear áudio porque a música e o som se resumem fundamentalmente a números, no sentido em que podemos descrevê-los utilizando números.

Aplicações da sonificação

O objetivo da sonificação é representar, apresentar e partilhar dados. Através do campo auditivo, os dados podem tornar-se mais acessíveis e compreensíveis para o maior número possível de utilizadores, especialmente para pessoas que têm dificuldade em compreender representações visuais de dados, podendo também ser utilizada para tornar os dados mais cativantes e memoráveis para todos.

A sonificação pode ser utilizada numa variedade de aplicações, tais como a visualização de dados científicos, a monitorização de condições ambientais e a criação de experiências multimédia interativas, mas também na educação, ao envolver os alunos na conceção de uma noção científica utilizando estímulos áudio em vez de visuais.

Eis alguns exemplos de como a sonificação é utilizada no mundo real:

Análise de dados científicos: A sonificação pode ser utilizada para analisar dados demasiado complexos ou abstratos para serem representados visualmente. Por exemplo, os cientistas têm utilizado a sonificação para analisar o comportamento dos átomos («Os sons dos átomos»)[4], a atividade dos neurónios no cérebro (Software interativo para a sonificação da atividade neuronal | HAL) [5] , e a evolução das galáxias (https://chandra.si.edu/sound/gcenter.html). A sonificação também pode ser aplicada quando os dados são registados numa sequência demasiado densa e, por isso, a manipulação temporal permite o aumento da escala audível ou transformações sonoras em durações maiores ou mais curtas, como por exemplo ao transformar o registo sismográfico de um terramoto em som. Monitorização das condições ambientais: A sonificação pode ser utilizada para monitorizar as condições ambientais em tempo real, por exemplo, para monitorizar o som do oceano a fim de acompanhar alterações na temperatura da água e nos níveis de poluição [6]

Criação de experiências multimédia interativas: a sonificação pode ser utilizada para criar experiências multimédia interativas que são mais imersivas e envolventes do que as interfaces visuais tradicionais. Por exemplo, a sonificação tem sido utilizada para criar mapas interativos [7], jogos educativos (CosmoBally - Sonokids) e experiências de realidade virtual.

Sonificação em tempo real vs. «a posteriori»

De acordo com a utilização do sistema de sonificação (para analisar ou monitorizar um determinado fenómeno), distinguimos dois «modos»: 1) em tempo real (para monitorizar) — um fluxo de dados é sonificado instantaneamente e é produzido um som para apresentar o valor e o comportamento dos dados nesse momento específico; 2) «a posteriori» (para analisar) — a sonificação de séries temporais de um conjunto de dados pré-gravados é convertida num ficheiro de áudio que apresenta os valores e o comportamento dos dados ao longo do período de tempo abrangido pela série temporal. Estes dois métodos não são mutuamente exclusivos e podem eventualmente apresentar os mesmos sons. A diferença é que no «a posteriori», como o som é produzido após a ocorrência dos eventos que originaram os dados, os parâmetros da peça final podem ser adaptados, ou seja, a duração total. No caso em tempo real, é possível controlar a resolução temporal: ou seja, o intervalo de tempo em que o som pode mudar e é reproduzido.

Ecologia acústica

A estética é importante. Um som pode ser mapeado com grande precisão, mas soar «horrível» para o utilizador. Isto pode ser considerado um defeito e, por conseguinte, limitar a eficácia do sistema, uma vez que o utilizador não suportará ouvi-lo. Por outro lado (por exemplo, nos alarmes), o som pode ser intencionalmente estridente e agressivo. A escolha do som de saída é, de certa forma, artística, no sentido de que deve ter em consideração o tipo de público e o seu gosto. Isso não significa que sejamos obrigados a reproduzir algo de que o utilizador vá gostar, mas, pelo menos, estar cientes do tipo de som que lhe é familiar. Mesmo que o gosto seja subjetivo, gostaríamos de recordar o trabalho realizado no campo da ecologia acústica. Existem alguns fatores comuns indicados por estudos de psicologia e também por modelos culturais de «beleza». No presente projeto, tal como o nome do projeto sugere, fazemos referência ao trabalho e à visão do compositor canadiano Murray Schafer, que popularizou o termo «paisagem sonora» no livro «The Tuning Of The World», em 1977 [8]. As paisagens sonoras podem ser consideradas, em termos simples, como uma composição da antropofonia, da geofonia e da biofonia de um determinado ambiente. O autor defende que nos tornámos insensíveis aos ricos sons do nosso ambiente, a que ele chama de «paisagem sonora». Esta paisagem sonora abrange todos os sons naturais e produzidos pelo homem que nos rodeiam, e Schafer acredita que devemos aprender a apreciá-la e a geri-la para um mundo melhor. O seu trabalho deu origem ao «movimento da ecologia acústica», que visa estudar a relação entre os seres humanos, os animais e a natureza, em termos de som e paisagens sonoras. O Instituto de Ecologia Acústica foi fundado para sensibilizar para o efeito dos ambientes acústicos ruidosos, comprovadamente prejudiciais para o aumento dos níveis de stress nos indivíduos quando imersos neles.

Exemplos

O SonarX é um software concebido para transformar imagens e vídeos em sons significativos para pessoas cegas e todos [9]. Funciona com o Pure Data [10] e pode ser descarregado deste repositório github [11]

Alguns elementos históricos

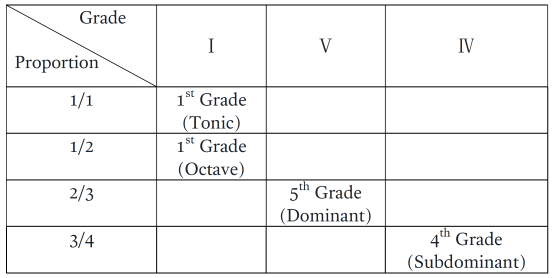

Os graus da escala musical como sonificação das razões fundamentais (1/2, 2/3, 3/4)

No sentido mais estrito da Teoria da Harmonia na Música, a compreensão das relações harmónicas que regem os sons tem origem nas proporções matemáticas que correspondem às dimensões de comprimento, tensão e às propriedades naturais dos materiais que os produzem [12]. The definition of the overall range and the intervals governing the diatonic scale clearly refers to the fundamental ratios of the Pythagorean “Tetraktys.”

Os Rácios

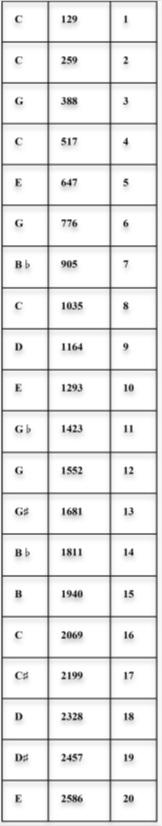

Se calcularmos o número de partes do material que são postas em movimento, ou seja, se o número «2» corresponder às duas partes iguais em que uma corda é dividida para produzir a oitava (que é novamente C, como mostrado na primeira coluna, mas mais agudo), e assumindo que são necessários 129 impulsos para produzir o C (Dó), então a tabela abaixo mostra o mapeamento das notas na coluna da esquerda e das frequências na coluna do meio, com o número de partes postas em movimento na terceira coluna.

A razão de 1 para 2 (1/2) também nos dá a razão de intervalo de uma oitava. Com base no diagrama de frequências correspondente (número de impulsos), a razão de frequências correspondente é 129/259. A razão de 2 para 3 (2/3) dá-nos, portanto, o intervalo, que por sua vez define a razão de frequências 259/388. A observação, portanto, de razões que possam surgir entre dois, ou mesmo mais, valores numéricos de cálculo, medição ou registo de séries de dados, também pode servir de estímulo para a criação de sonificação.

A escala cromática de doze notas, a «teoria dos conjuntos» e o seraísmo holístico

O conceito histórico de «corresponder as notas» da escala diatônica à sequência dos números naturais remonta ao século XVII; no entanto, foi o filósofo e músico Jean-Jacques Rousseau (1712–1778) o primeiro a apresentar formalmente esta ideia na Academia Francesa de Ciências.

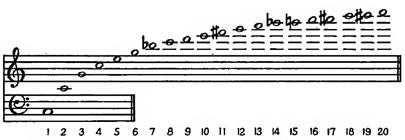

De acordo com isto, cada nota sucessiva da escala musical pode ser numerada na sequência dos números naturais. Por exemplo, se atribuirmos a A (A na solfejo latina) o número 1, temos a seguinte correspondência (tabela de correspondências):

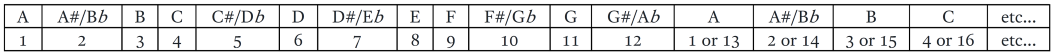

If the scale is also chromatic, then we can have the following arrangement:

The case of Xenakis’ “Polyagogia”

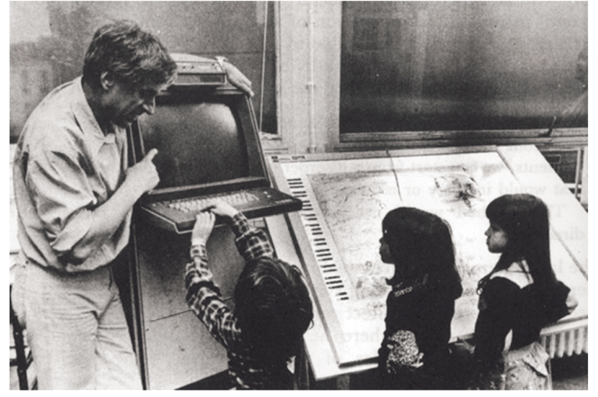

Iannis Xenakis (1922–2001) was a pioneering architect and composer of the 20th century. The concept of schematic sonification using electronic means, as described above—that is, the conversion of a shape into sound in a manner analogous to the conversion of data into a graph—was studied by Xenakis as early as the 1950s, but it took its final form in the late 1970s. By bypassing the mediation of formal education, Xenakis dared to establish a world of holistic sonic experience as he conceived, designed, and implemented the sonic rendering of graphs in the form of a comprehensive system. This system included an electromagnetic stylus on an architectural design canvas, connected to a computer and speakers; it was named in Greek “Polyagogia” ("Πολυαγωγία", Unité Polyagogique Informatique de CEMAMu/U.P.I.C.) The pedagogical dimension of this connection was emphasized early on by Xenakis. The image below clearly illustrates this connection, as the architectural canvas corresponds to the keys of a piano (vertically on the screen).

The Iannis Xenakis Center (Centre Iannis Xenakis) has developed a modern educational version of UPIC as an application, titled UPISKETCH, which is freely available on this page: https://www.centre-iannis-xenakis.org/upisketch?lang=en

References

- ↑ "The Sonification Report: Status of the Field and Research Agenda", Gregory Kramer, Bruce N. Walker, Terri Bonebright, Perry Cook, John Flowers, Nadine Miner, 1999, International Community for Auditory Display (ICAD)

- ↑ Hermann, T., Walker, B., & Cook, P. R. (2011). Sonification handbook. Springer.

- ↑ wikipedia as on 9th of April 2024

- ↑ "The sound of an atom has been captured" (K 2025 news article) - http://www.themindgap.nl/?p=245

- ↑ Argan Verrier, Vincent Goudard, Elim Hong, Hugues Genevois. Interactive software for the sonifica- tion of neuronal activity. Sound and Music Computing Conference, AIMI (Associazione Italiana di Informatica Musicale); Conservatorio “Giuseppe Verdi” di Torino, Università di Torino, Politecnico di Torino, Jun 2020, Torino (Virtual Conference), Italy. hal-04041917

- ↑ (Data Sonification: Acclaimed Musician Transforms Ocean Data into Music) https://www.hubocean.earth/blog/data-sonification as on 23rd September 2024

- ↑ Interactive 3D sonification for the exploration of city maps | Proceedings of the 4th Nordic conference on Human-computer interaction: changing roles

- ↑ Schafer, R. M. (1977). The Tuning of the World. New York: Knopf.

- ↑ S. Cavaco, J.T. Henrique, M. Mengucci, N. Correia, F. Medeiros, Color sonification for the visually impaired, in Procedia Technology, M. M. Cruz-Cunha, J. Varajão, H. Krcmar and R. Martinho (Eds.), Elsevier, volume 9, pages 1048-1057, 2013.

- ↑ http://puredata.info/

- ↑ https://github.com/LabIO/Sonarx-45 as on 23rd September 2024

- ↑ P.Stergiopoulos Music and STEM. Multiple sides of the same coin. International Conference | STE(A)M educators & education. Conference proceedings STEAM on EDU 2021,, p.202-220. ISBN: 978-618-5497-24-8. (Link: https://www.schoolofthefuture.eu/sites/default/files/2026-02/Music%20and%20STEM%20-%20Multiple%20sides%20of%20the%20same%20coin.pdf)