What is sonification/pt: Difference between revisions

David Sousa (talk | contribs) (Created page with "O objetivo da sonificação é representar, apresentar e partilhar dados. Através do campo auditivo, os dados podem tornar-se mais acessíveis e compreensíveis para o maior número possível de utilizadores, especialmente para pessoas que têm dificuldade em compreender representações visuais de dados, podendo também ser utilizada para tornar os dados mais cativantes e memoráveis para todos. A sonificação pode ser utilizada numa variedade de aplicações, tais c...") |

David Sousa (talk | contribs) (Created page with "== Sonificação em tempo real vs. «a posteriori» ==") |

||

| Line 32: | Line 32: | ||

Criação de experiências multimédia interativas: a sonificação pode ser utilizada para criar experiências multimédia interativas que são mais imersivas e envolventes do que as interfaces visuais tradicionais. Por exemplo, a sonificação tem sido utilizada para criar mapas interativos <ref>Interactive 3D sonification for the exploration of city maps | Proceedings of the 4th Nordic conference on Human-computer interaction: changing roles</ref>, jogos educativos (CosmoBally - Sonokids) e experiências de realidade virtual. | Criação de experiências multimédia interativas: a sonificação pode ser utilizada para criar experiências multimédia interativas que são mais imersivas e envolventes do que as interfaces visuais tradicionais. Por exemplo, a sonificação tem sido utilizada para criar mapas interativos <ref>Interactive 3D sonification for the exploration of city maps | Proceedings of the 4th Nordic conference on Human-computer interaction: changing roles</ref>, jogos educativos (CosmoBally - Sonokids) e experiências de realidade virtual. | ||

< | <span id="Real-time_sonification_vs_'a_posteriori'"></span> | ||

== | == Sonificação em tempo real vs. «a posteriori» == | ||

<div lang="en" dir="ltr" class="mw-content-ltr"> | <div lang="en" dir="ltr" class="mw-content-ltr"> | ||

Revision as of 11:09, 6 April 2026

Quando emitimos um som para comunicar algo, estamos a aplicar um sistema de sonificação. Representamos dados no domínio auditivo. Transformamos dados em sons; esses dados podem, geralmente, representar qualquer coisa que possa ser expressa em números: uma medição física, uma noção, uma ação ou uma sequência de valores provenientes de um sensor. Foram criadas muitas definições para este processo denominado sonificação: desde «subtipo de representações auditivas que utilizam áudio não verbal para representar informação», até «transformação de relações de dados em relações percebidas num sinal acústico com o objetivo de facilitar a comunicação ou a interpretação». [1] e, de forma mais definitiva e precisa, «geração de som dependente de dados, desde que a transformação seja sistemática, objetiva e reproduzível» [2], e, por fim, «técnica de transformar dados não audíveis em som que possa ser captado pelo ouvido humano» [3]. Para simplificar, no contexto deste manual, podemos afirmar resumidamente que «a sonificação é o processo de gerar som a partir de qualquer tipo de dados para representar a informação que estes contêm sob a forma de áudio». Em termos ainda mais simples, podemos explicar a um aluno que a sonificação descreve os dados através do som, tal como a visualização o faz através de gráficos, fluxogramas, histogramas, etc.

Basicamente, queremos combinar dados (entrada) e sons (saída) e definir a forma como estes dois se relacionam (mapeamento ou protocolo). Assim, um sistema de sonificação é definido por estas três partes:

1 - Dados de entrada 2 - Sons de saída 3 - Mapeamento ou protocolo

Tipo de dados e utilização da sonificação

A sonificação é cada vez mais utilizada como ferramenta científica para analisar e monitorizar dados de vários fenómenos, tendo evoluído especialmente na comunidade astronómica devido às grandes quantidades de dados produzidos pela observação do cosmos, mas também como ferramenta artística e complemento educativo para outras disciplinas, como a medicina, a matemática, a física, a química, mas também a geografia, a economia ou mesmo a literatura. Por exemplo, na medicina, os médicos monitorizam as reações biométricas dos pacientes em tempo real sem terem de olhar para um ecrã. Na literatura, é possível criar uma representação áudio «a posteriori» utilizando o número de adjetivos num livro ou o número de vezes que uma determinada palavra aparece num artigo. Qualquer tipo de dados é composto por números. E os números podem desencadear áudio porque a música e o som se resumem fundamentalmente a números, no sentido em que podemos descrevê-los utilizando números.

Aplicações da sonificação

O objetivo da sonificação é representar, apresentar e partilhar dados. Através do campo auditivo, os dados podem tornar-se mais acessíveis e compreensíveis para o maior número possível de utilizadores, especialmente para pessoas que têm dificuldade em compreender representações visuais de dados, podendo também ser utilizada para tornar os dados mais cativantes e memoráveis para todos.

A sonificação pode ser utilizada numa variedade de aplicações, tais como a visualização de dados científicos, a monitorização de condições ambientais e a criação de experiências multimédia interativas, mas também na educação, ao envolver os alunos na conceção de uma noção científica utilizando estímulos áudio em vez de visuais.

Eis alguns exemplos de como a sonificação é utilizada no mundo real:

Análise de dados científicos: A sonificação pode ser utilizada para analisar dados demasiado complexos ou abstratos para serem representados visualmente. Por exemplo, os cientistas têm utilizado a sonificação para analisar o comportamento dos átomos («Os sons dos átomos»)[4], a atividade dos neurónios no cérebro (Software interativo para a sonificação da atividade neuronal | HAL) [5] , e a evolução das galáxias (https://chandra.si.edu/sound/gcenter.html). A sonificação também pode ser aplicada quando os dados são registados numa sequência demasiado densa e, por isso, a manipulação temporal permite o aumento da escala audível ou transformações sonoras em durações maiores ou mais curtas, como por exemplo ao transformar o registo sismográfico de um terramoto em som. Monitorização das condições ambientais: A sonificação pode ser utilizada para monitorizar as condições ambientais em tempo real, por exemplo, para monitorizar o som do oceano a fim de acompanhar alterações na temperatura da água e nos níveis de poluição [6]

Criação de experiências multimédia interativas: a sonificação pode ser utilizada para criar experiências multimédia interativas que são mais imersivas e envolventes do que as interfaces visuais tradicionais. Por exemplo, a sonificação tem sido utilizada para criar mapas interativos [7], jogos educativos (CosmoBally - Sonokids) e experiências de realidade virtual.

Sonificação em tempo real vs. «a posteriori»

According to the use of the sonification system (to analyze or to monitor a certain phenomena) we distinguish two “modes”: 1) in real-time (to monitor) - a stream of data is sonifed instantly and a sound is produced to display the value and behavior of the data in that particular moment; 2) “ a posteriori” (to analyze) - time-series sonification of a set of pre-recorded data is converted into an audio file that displays the values and behavior of the data over the period of time covered by the time-series. These two methods are not mutually exclusive and can eventually display the same sounds.The difference is that in “a posteriori”, as the sound is produced after the events that originated the data happened, the parameters of the final piece can be adapted, i.e.the total duration. In a real-time case, you can control the time resolution: that is the time interval at which the sound can change and is played.

Acoustic ecology

The aesthetic is important. A sound can be mapped very precisely but sounds “awful” to the user. This could be considered as a defect and therefore it could limit the efficacy of the system because the user will not bear listening to it. On the other side (i.e. in alarms) the sound can be intentionally noisy and aggressive. The choice of the output sound is in some way artistic in a sense that it must take into consideration the type of audience and its taste. It does not mean that we are obliged to play something that the user will like, but at least be aware of what type of sound is familiar to him/her. Even if the taste is subjective we would like to recall the work done in the field of acoustic ecology. There are some common factors indicated by psychology studies and also cultural models of “beauty”. In the present project, as the name of the project suggests, we reference the work and vision of the Canadian composer Murray Schafer, who popularized the term “soundscape” in the book “The Tuning Of The World” in 1977[8]. Soundscapes can be simply considered as a composition of the anthrophony, geophony and biophony of a particular environment. The author argues that we've become desensitized to the rich sounds of our environment, which he calls the "soundscape." This soundscape encompasses all the natural and human-made sounds that surround us, and Schafer believes we should learn to appreciate and manage it for a better world.His work generated the “acoustic ecology movement” which aims to study the relationship between humans, animals and nature, in terms of sound and soundscapes. The Acoustic Ecology Institute was founded to raise consciousness of the effect of noisy acoustic environments, proven to be harmful for increasing stress levels on individuals when immersed in these.

Examples

SonarX is a software designed to transform images and video into meaningful sound for blind individuals and all[9]. It runs on Pure Data [10] and can be downloaded at this [11] github repository.

Some historic elements

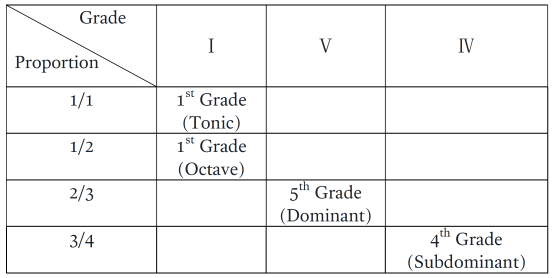

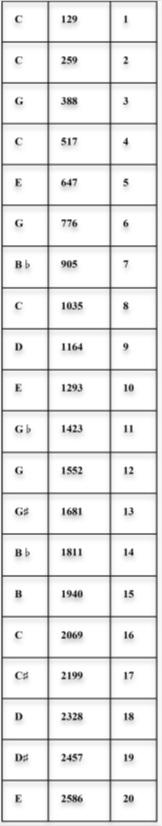

The grades of the musical scale as a sonification of the fundamental ratios (1/2, 2/3, 3/4)

In the strictest sense of the Theory of Harmony in Music, the understanding of the harmonic relationships that govern sounds is rooted in the mathematical ratios that correspond to the dimensions of length, tension, and the natural properties of the materials that produce them[12]. The definition of the overall range and the intervals governing the diatonic scale clearly refers to the fundamental ratios of the Pythagorean “Tetraktys.”

The Ratios

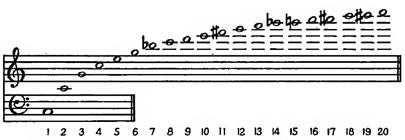

If we calculate the number of parts of the material that are set in motion, that is, if the number “2” corresponds to the two equal parts into which a string is divided to produce the octave (which is again C, as shown in the first column, but sharper), and assuming that 129 pulses are required to produce C (Do), then the table below shows the mapping of notes in the left column and frequencies in the middle column, with the number of parts set in motion in the third column.

The ratio of 1 to 2 (1/2) also gives us the interval ratio of an octave. Based on the corresponding frequency diagram (number of pulses), the corresponding frequency ratio is 129/259. The ratio 2 to 3 (2/3) therefore gives us the interval, which in turn defines the frequency ratio 259/388. The observation, therefore, of ratios that may arise between two, or even more, numerical values of calculation, measurement, or data series logging, can also serve as a stimulus for creating sonification.

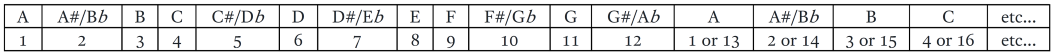

The twelve note chromatic scale, the “set theory” and the holistic seraism

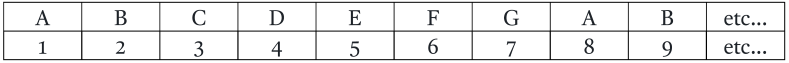

The historical concept of “mapping the notes” of the diatonic scale to the sequence of natural numbers dates back as far as the 17th century, however, philosopher and musician Jean-Jacques Rousseau (1712–1778) was the first to formally present this idea in the French Academy of Sciences.

According to this, each successive note of the musical scale can be numbered in the sequence of natural numbers. For example, if we assign A (A in the Latin solfège) the number 1, then we have the following correspondence (correspondence chart):

If the scale is also chromatic, then we can have the following arrangement:

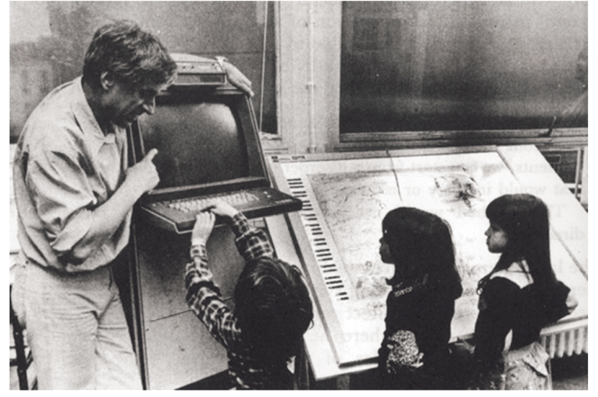

The case of Xenakis’ “Polyagogia”

Iannis Xenakis (1922–2001) was a pioneering architect and composer of the 20th century. The concept of schematic sonification using electronic means, as described above—that is, the conversion of a shape into sound in a manner analogous to the conversion of data into a graph—was studied by Xenakis as early as the 1950s, but it took its final form in the late 1970s. By bypassing the mediation of formal education, Xenakis dared to establish a world of holistic sonic experience as he conceived, designed, and implemented the sonic rendering of graphs in the form of a comprehensive system. This system included an electromagnetic stylus on an architectural design canvas, connected to a computer and speakers; it was named in Greek “Polyagogia” ("Πολυαγωγία", Unité Polyagogique Informatique de CEMAMu/U.P.I.C.) The pedagogical dimension of this connection was emphasized early on by Xenakis. The image below clearly illustrates this connection, as the architectural canvas corresponds to the keys of a piano (vertically on the screen).

The Iannis Xenakis Center (Centre Iannis Xenakis) has developed a modern educational version of UPIC as an application, titled UPISKETCH, which is freely available on this page: https://www.centre-iannis-xenakis.org/upisketch?lang=en

References

- ↑ "The Sonification Report: Status of the Field and Research Agenda", Gregory Kramer, Bruce N. Walker, Terri Bonebright, Perry Cook, John Flowers, Nadine Miner, 1999, International Community for Auditory Display (ICAD)

- ↑ Hermann, T., Walker, B., & Cook, P. R. (2011). Sonification handbook. Springer.

- ↑ wikipedia as on 9th of April 2024

- ↑ "The sound of an atom has been captured" (K 2025 news article) - http://www.themindgap.nl/?p=245

- ↑ Argan Verrier, Vincent Goudard, Elim Hong, Hugues Genevois. Interactive software for the sonifica- tion of neuronal activity. Sound and Music Computing Conference, AIMI (Associazione Italiana di Informatica Musicale); Conservatorio “Giuseppe Verdi” di Torino, Università di Torino, Politecnico di Torino, Jun 2020, Torino (Virtual Conference), Italy. hal-04041917

- ↑ (Data Sonification: Acclaimed Musician Transforms Ocean Data into Music) https://www.hubocean.earth/blog/data-sonification as on 23rd September 2024

- ↑ Interactive 3D sonification for the exploration of city maps | Proceedings of the 4th Nordic conference on Human-computer interaction: changing roles

- ↑ Schafer, R. M. (1977). The Tuning of the World. New York: Knopf.

- ↑ S. Cavaco, J.T. Henrique, M. Mengucci, N. Correia, F. Medeiros, Color sonification for the visually impaired, in Procedia Technology, M. M. Cruz-Cunha, J. Varajão, H. Krcmar and R. Martinho (Eds.), Elsevier, volume 9, pages 1048-1057, 2013.

- ↑ http://puredata.info/

- ↑ https://github.com/LabIO/Sonarx-45 as on 23rd September 2024

- ↑ P.Stergiopoulos Music and STEM. Multiple sides of the same coin. International Conference | STE(A)M educators & education. Conference proceedings STEAM on EDU 2021,, p.202-220. ISBN: 978-618-5497-24-8. (Link: https://www.schoolofthefuture.eu/sites/default/files/2026-02/Music%20and%20STEM%20-%20Multiple%20sides%20of%20the%20same%20coin.pdf)